OpenClaw(原Moltbot/Clawdbot)作为开源本地优先AI代理平台,通过阿里云轻量应用服务器可实现快速部署,集成百炼大模型后,将AI从“聊天伙伴”升级为“数字员工”。该方案结合云服务器稳定架构与自主可控特性,支持钉钉远程操控,适配企业级任务处理场景。文章系统解析计费逻辑、全流程配置步骤、个性化定制能力,并针对部署难点提供FAQ解答,助力用户构建高效专属AI服务,实现文本生成与任务自动化双突破。

一、计费说明

在轻量应用服务器上部署并使用OpenClaw服务将产生以下费用:

- 轻量应用服务器费用:目前轻量应用服务器2核2G配置峰值200M带宽,40GB ESSD云盘,抢购价38元1年,新用户专属优惠价68元1年;2核4G配置峰值200M带宽,50GB ESSD系统盘,抢购价9.9元1个月、199元1年,可选OpenClaw应用镜像。详情可参考开年焕新活动:https://www.aliyun.com/daily-act/ecs/activity_selection

- 模型调用费用:OpenClaw执行过程中默认调用百炼模型。模型调用的主要计费方式有两种:

- Coding Plan AI 编码套餐(推荐):采用固定月费模式,提供月度请求额度,超出时段限额的调用会报错且不计费用,可避免产生超出预期的费用。Coding Plan 目前支持

qwen3.5-plus、kimi-k2.5、MiniMax-M2.5、glm-5等模型。 - 按Token用量计费:

OpenClaw 2026.2.26版本:默认使用qwen3.5-plus模型作为文本和图像处理模型。

- Coding Plan AI 编码套餐(推荐):采用固定月费模式,提供月度请求额度,超出时段限额的调用会报错且不计费用,可避免产生超出预期的费用。Coding Plan 目前支持

配置免费额度用完即停:首次开通阿里云百炼时,会自动发放各模型的新人免费额度。访问阿里云百炼-中国大陆版:https://bailian.console.aliyun.com/cn-beijing#/home 阅读并同意协议后,系统将自动开通阿里云百炼并发放免费推理额度。免费额度消耗完后,默认将按模型列表中的价格与用量计费,建议开启免费额度用完即停功能,避免产生额外费用。另外,大模型全量抵扣优惠套餐,目前优惠价为10元/月起,详情可参考:https://www.aliyun.com/benefit/scene/ai-discount

二、购买OpenClaw套餐

如果已购买轻量应用服务器,可以跳过此步骤,以重置系统的方式部署OpenClaw(重置系统时选择应用镜像下的OpenClaw镜像),但重置系统会清除轻量应用服务器上的系统盘数据,请根据需要做好数据备份。

- 购买预装OpenClaw应用的轻量应用服务器,如上文所介绍的轻量应用服务器2核4G配置9.9元1个月、199元1年。该应用镜像基于Alibaba Cloud Linux 3.2104 LTS 64位操作系统,来源于阿里云计算巢。

- 在轻量应用服务器页面,预置了资源配置,如要更改配置项,请参考下面内容。

- 实例:内存必须2GiB及以上,可以根据自己的需求切换套餐。

- 地域:默认北京。

- 购买配置:默认12个月,可以根据自己的需求切换时长。

三、配置OpenClaw

- 在轻量应用服务器-控制台:https://swasnext.console.aliyun.com/servers,单击服务器卡片中的实例ID,在服务器概览页面单击应用详情页签。

- 在OpenClaw使用步骤区域中,单击端口放通下的执行命令,可开放获取OpenClaw服务运行端口的防火墙。重要

- 为了防止恶意扫描与定向攻击,OpenClaw 在初始化时不再使用固定的默认端口,而是自动生成一个随机端口,可在控制台[查看OpenClaw的端口号。

- 端口放通将使服务暴露于公网,支持一键关闭 WebUI 公网访问。

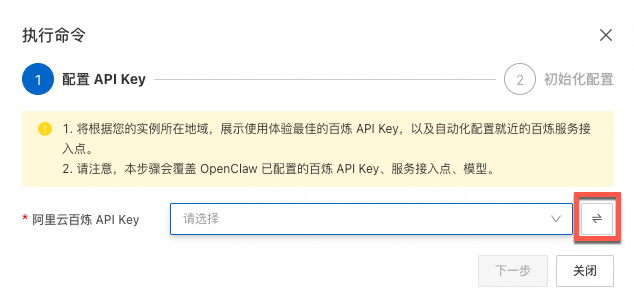

- 单击配置OpenClaw下的执行命令配置百炼API key。目前支持配置两种类型的百炼API Key:

- Coding Plan 套餐专属 API Key(推荐):采用固定月费模式,提供月度请求额度,超出时段限额的调用会报错且不计费用,可避免产生超出预期的费用。Coding Plan 目前支持

qwen3.5-plus、kimi-k2.5、MiniMax-M2.5、glm-5等模型。 - 按Token用量计费的百炼API Key。

- 系统推荐(下拉选择)选择完成后单击下一步。轻量应用服务器所在地域系统推荐的百炼API Key对应地域Coding Plan的API key对应地域中国内地地域华北2(北京)华北2(北京)美国及欧洲地域美国(弗吉尼亚)华北2(北京)中国香港及其他亚洲地域新加坡华北2(北京)

- 手动输入单击按钮切换至手动输入,输入百炼API Key并选择该API Key对应地域,单击下一步。

- Coding Plan 套餐专属 API Key(推荐):采用固定月费模式,提供月度请求额度,超出时段限额的调用会报错且不计费用,可避免产生超出预期的费用。Coding Plan 目前支持

说明:手动配置需确保选择的API Key对应地域正确,否则会导致模型无法正常调用。

- 单击访问Web UI面板下的获取地址,获取OpenClaw WebUI的地址,可以在Web页面与OpenClaw的Agent对话。可根据需求关闭OpenClaw WebUI的公网访问一键关闭WebUI的公网访问权限。

- (可选)查看Token。在应用详情 > 基础配置 > 查看Token中单击查看,查看并保存Token。

注意事项:请勿泄露包含 Token 的完整 URL。该链接包含身份验证凭据,任何持有此链接的人都能直接绕过登录验证,获得 OpenClaw 控制台的管理员权限。

四、配置消息渠道

OpenClaw可以在聊天应用上与你交流。所有渠道都支持文本,图片、视频等消息的回复支持因渠道而异。阿里云为您在轻量应用服务器控制台的应用详情界面上提供了钉钉、飞书、企业微信、QQ消息渠道的快速接入通道,详细教程可通过OpenClaw专属活动:https://www.aliyun.com/activity/ecs/clawdbot 快速接入企业微信、QQ、钉钉、飞书,助你玩转OpenClaw,查询部署教程,如下图所示:

五、OpenClaw个性化配置

通用Agent表现得“千人一面”,难以满足特定场景下的交互需求。为了让 OpenClaw 的 Agent 真正融入业务场景(如沉浸式角色扮演、严谨的企业客服等),OpenClaw 提供了个性化配置能力。

具体配置文件包括:

- 性格定义(SOUL.md):定义 AI 的核心价值观、对话风格(如严肃、幽默、简洁)以及行为准则。

- 身份定义(IDENTITY.md****:定义 AI 的姓名、自我认知、背景设定以及角色定位。

- 工作方式定义(AGENTS.md****:定义 AI 处理任务的逻辑、工具使用规则以及工作流。

配置步骤:在应用详情 > 个性化配置中单击编辑修改不同的配置文件。

六、常见问题

如何重启OpenClaw网关?

当遇到连接中断或服务不可用等场景时,可在控制台页面重启OpenClaw网关。在应用详情 > 基础配置 > 重启OpenClaw网关中单击执行命令。

如何查看OpenClaw的端口号?

为了防止恶意扫描与定向攻击,OpenClaw 在初始化时不再使用固定的默认端口,而是自动生成一个随机端口。在应用详情 > 基础配置 > 查看端口中单击执行命令查看OpenClaw的端口号。

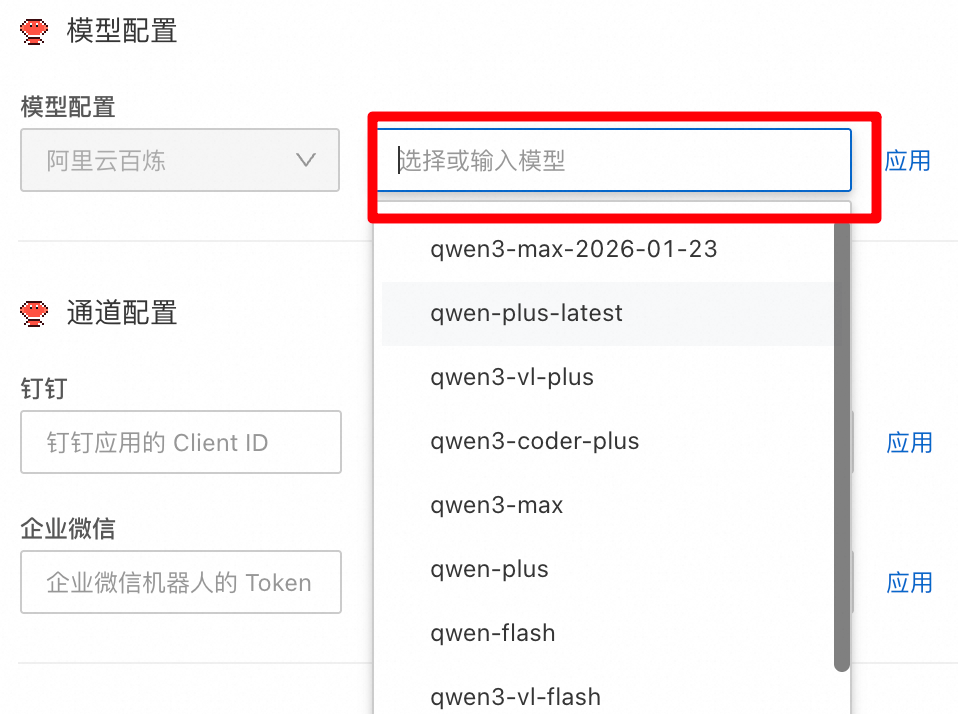

如何更改OpenClaw调用的模型?

1、控制台切换

OpenClaw集成了阿里云百炼平台,在页面切换不同的模型。在应用详情 > 模型配置 > 模型配置中删除默认的模型,然后下拉选择不同的百炼模型。

支持手动输入模型名,模型Code可以在百炼模型广场页面查询。

2、手动修改配置

- 在轻量应用服务器控制台-服务器页面,单击部署了OpenClaw的服务器卡片中的实例ID,进入服务器概览页面。

- 单击应用详情页签,在访问控制页面单击快速查看可进入Clawdbot对话页面。

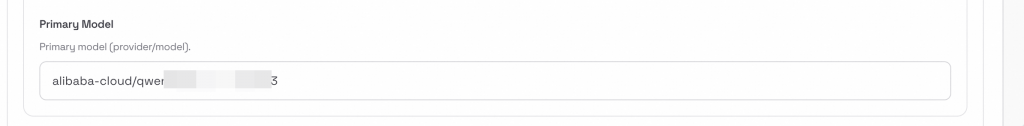

- 单击Config > Agents,搜索Primary Model或Image Model,更改为百炼中支持的模型,填写格式为

alibaba-cloud/模型Code,如alibaba-cloud/qwen3-max-2026-01-23,模型Code可以在百炼模型广场页面查询。

如何开启/关闭OpenClaw WebUI的公网访问?

用户可根据自身需求一键关闭OpenClaw WebUI的公网访问权限。在应用详情 > 基础配置 > 公网访问中单击开启/关闭控制OpenClaw WebUI的公网访问能力。

为什么填写API Key时系统不识别我已有的百炼API Key?

系统会自动检测离当前服务器所在地域最近的百炼模型接入点,并展示其对应的API Key(如果订阅了百炼Coding Plan,会同时展示其API Key)。如果不存在就近接入点对应的API Key,可按界面操作在对应的地域创建API Key或订阅Coding Plan。

| 轻量应用服务器所在地域 | 系统推荐的百炼API Key对应地域 | Coding Plan的API key对应地域 |

|---|---|---|

| 中国内地地域 | 华北2(北京) | 华北2(北京) |

| 美国及欧洲地域 | 美国(弗吉尼亚) | 华北2(北京) |

| 中国香港及其他亚洲地域 | 新加坡 | 华北2(北京) |

为什么我的OpenClaw的默认模型不是qwen3.5-plus?

目前只有最新的镜像版本OpenClaw 2026.2.26默认使用qwen3.5-plus 模型。其他版本的默认模型如下:

OpenClaw 2026.2.3和OpenClaw 2026.2.9版本:默认使用qwen3-max-2026-01-23模型作为文本处理模型(Primary Model),qwen3-vl-plus模型作为图像处理模型(Image Model)。OpenClaw(Moltbot) 2026.1.27-beta.1版本:2026年1月31日及之后购买的服务器默认使用qwen3-max-2026-01-23模型,2026年1月31日之前默认使用qwen-vl-plus模型。

如需更换模型可手动更改OpenClaw调用的模型。